[기자수첩] 챗GPT의 가능성과 한계

챗GPT 출시 1주일, 일반 업무는 대체가능, 전문 업무는 대체불가능 여전히 인간 업무 대체는 어려우나 기초 업무에는 영향 줄 가능성 높아 마이크로소프트, 10억 달러에 챗GPT 지분 인수 후 검색 엔진에 활용 예정

챗GPT가 출시된지 1주일이 지났다. 기존의 챗GPT2, 챗GPT3을 뛰어넘는 챗GPT4를 보여주겠다고 공언했으나 현재 서비스는 챗GPT3.5 수준이라 아직까지 더 많은 발전이 필요하다는 설명을 하고 있으나, 사용자 층의 반응은 놀랍다.

영어권 질문 및 답변 서비스로 유명한 쿼라(Quora.com)에서는 쿼라에서 받은 답변과 유사한 답변을 챗GPT로부터 받았다는 답변도 공유되고 있고, 그 외에 주요 영어권 커뮤니티인 레딧(Reddit) 등에서도 연일 챗GPT의 다양한 답변이 화제가 되고 있는 상황이다.

기존 모델과의 차이점은?

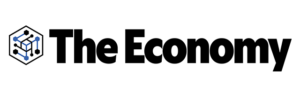

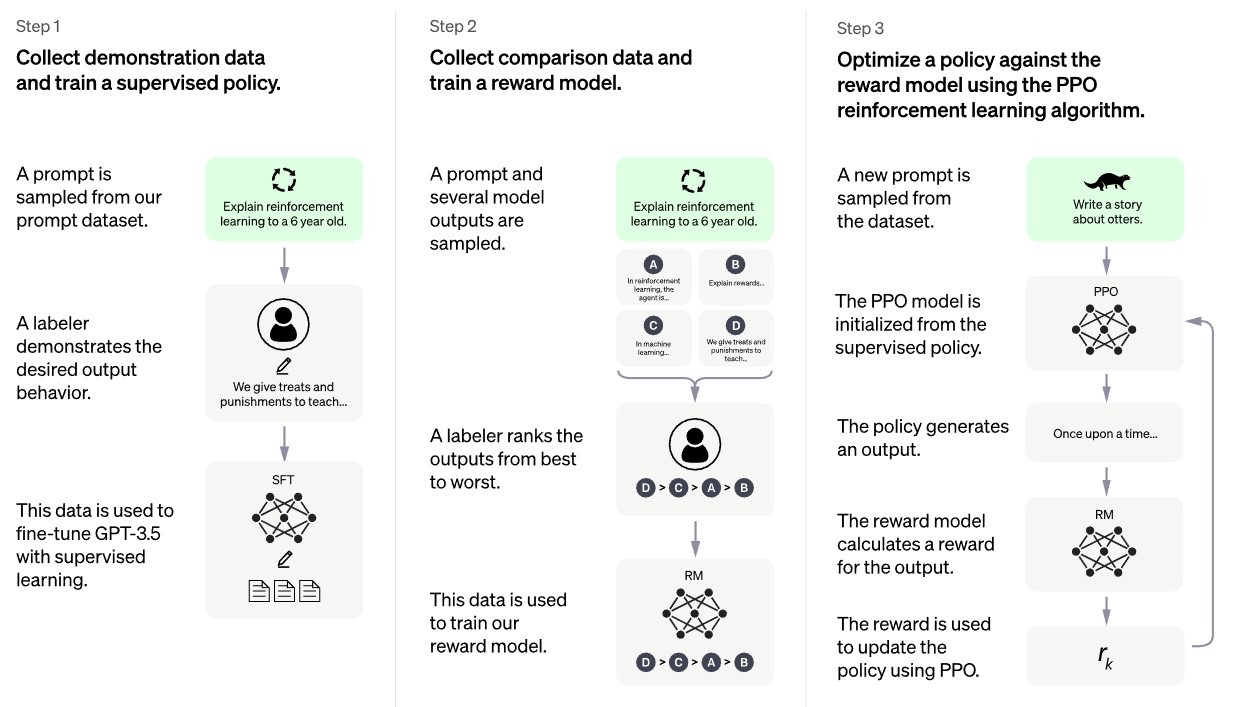

스위스 AI대학의 이경환 교수에 따르면, 기존의 챗GPT 모델들과 달리 인간의 반응을 활용해 답변을 보정하는 ‘인간 피드백형 강화학습’이 신형 챗GPT 모델의 핵심이라고 지적한다.

지난 2017년 알파고가 나왔을 때 활용되었던 ‘강화학습’ 모델이 바둑판 위에서는 오차 수정을 할 이유가 크게 없었기 때문에 문제 없이 작동할 수 있었으나, 바둑판을 벗어나 다양한 데이터를 활용하는 챗GPT의 경우는 ‘바둑의 승리’라는 기준 값이 없기 때문에, 적절한 기준 값을 골라주기 위한 변형이 있었다고 설명했다. 특히, 모델 변형이 채팅 형태의 대화에서 인간의 반응을 바탕으로 하기 때문에 이용자가 늘어날 경우 정확도가 지속적으로 상승할 가능성도 지적했다.

인간의 반응을 중요한 잣대로 삼는다는 점에서 경제학의 현시선호이론(Revealed Preference Theory)가 인공지능 모델 안에 편입되어 보다 인간적인 결과물을 얻어낼 수 있게 된 점도 주목했다.

정말 인간 업무를 대체할 수 있나?

그러나, 인간의 일반적인 패턴을 찾아내 유사한 정보를 전달해 줄 수 있을 뿐, 구체적인 인간 반응을 모두 반영하는 것을 힘들 것이라며, 인간 업무를 완전히 대체하기 보다, 단조롭고 반복적인 업무 일부를 보조하는 것은 현재까지의 인공지능보다 더 높은 정확도로 서비스가 가능할 것이라고 전망했다.

특히, 법조계, 의료계 등의 업무 중 가장 빈번한 패턴인 단순 형량 계산, 감기약 처방 등의 업무는 일반적인 패턴으로 확인할 수 있을만큼 반복적인데다 특성화 패턴이 드물기 때문에 업무 대체가 가능할 수도 있다고 밝혔다. 그럼에도 불구하고 대부분의 전문업무를 대체할 수 없기 때문에, 초·중·고교의 단조로운 과제 대행, 광고 블로그 초안 작성 등의 업무 지원에 그칠 뿐, 경력직 업무자를 대체하는 것은 어려울 것이라는 의견을 내놨다.

가능한 업무 영역을 구분할 수 있는 잣대에 대한 질문에 대한 답변으로, 챗GPT가 근거하고 있는 현시선호 기반의 인간 선택 정보가 인공지능에서 어떻게 활용되는지를 가늠해봐야 할 것이라고 지적했다.

현시선호이론 기반의 인공지능, 인간적이나 전문적이지는 않아

현시선호란 주어진 여러 선택지 중 특정 선택을 한 정보를 바탕으로 다른 선택지보다 선택된 선택지가 더 선호될 것이라는 가정을 말한다. 그러나 이론상의 여러 공리(Axiom) 중 완비성, 이행성 등의 주요 요소가 현실에 맞지 않는 경우가 많은데다, 다양한 사용자의 반응을 모두 모아야 하는 만큼, 둘 이상의 사용자가 전혀 다른 선호도를 갖고 있을 경우 이행성이 깨지게 된다는 점도 지적했다. 이행성이 깨지는 데이터가 입력될 경우 가장 최근의 데이터에 우선권을 배정하는 방식으로 모델이 구축되어 있어 최근 데이터에 의존적으로 인공지능이 작동하는 탓에 한쪽 성향의 정보가 쌓이게 될 우려도 지적했다.

이어, 인간의 반응 데이터에 의존하다보니 소수의 전문가들로 부터 정보를 얻기보다, 다수의 일반인들로 부터 얻은 정보로 만들어지는 답변도 전문성을 띠기 어려울 것으로 내다봤다.

실제로 국내 국제영어대학원대학교에서 케임브리지 대학의 영어교육 프로그램을 가르치는 크리스토퍼 도로프(Christopher Douloff) 강사는 학생들의 과제에 대한 일반적인 답변을 만들어 내기는 했으나, 자신이 직접 지적하는 답변을 만들어내지는 못해 실제 업무에 활용할 수는 없었다고 밝혔다.

영어권의 유명 커뮤니티인 레딧(Reddit)에서도 챗GPT가 대부분의 단조로운 답변을 내놓는 와중에 종종 엉뚱한 답변을 내놓아 논란이 되는 상황이다. 한 생물학 연구인력은 자신의 전공 논문 관련 정보를 입력 후 틀린 부분을 지적해달라는 요청을 냈으나 용어를 잘못 이해하고 엉뚱한 답변을 내놨다는 경험을 공유하기도 했다.

업계에서는 전문성이 요구되는 업무에 쓰기보다, 일상의 단조로운 업무와 검색 지원 등에 쓰일 수 있는 가능성을 지적하고 있다. 특히 마이크로소프트가 10억 달러 이상의 투자를 통해 챗GPT를 인수하려는 계획을 세웠다는 보도가 나온 가운데, 그간 구글에 밀려 검색 엔진 점유율이 크게 낮았던 ‘빙(Bing)’의 서비스 확대와 아마존의 클라우드 서비스인 AWS와 경쟁 중인 애져(Azure)의 기술 지원에 쓰일 수 있는 가능성이 언급되고 있기도 하다.

국내에서는 한국어 정보가 2021년까지 밖에 없는 탓에 여전히 문재인 전 대통령을 현 대통령으로 언급하는데다, 문법이 틀린 문장을 연이어 언급하고 있어 당분간은 직접 사용이 어려울 것이라는 해석이 나오고 있다. 한 AI기반 채팅 서비스를 개발 중인 스타트업 대표는 “그간 챗GPT-2만으로도 많은 도움이 됐기 때문에, 적정한 가격대로 서비스가 출시되면 비용 문제로 쓰지 못했던 챗GPT-3 이상을 활용한 서비스에 도전하는 회사들이 나올 것”이라고 전망하기도 했다.