[해외 DS] 챗봇 의료 정보 제공, “영어는 척척, 스페인어·힌디어·중국어는 아직 부족해”

GPT-3.5와 메드알파카, 영어 질문에 대한 답변은 비교적 정확하지만, 스페인어·힌디어·중국어 질문에는 오류가 많아

특히 힌디어 질문에 대한 답변 오류율이 45%로 가장 높아

챗봇이 질문의 맥락을 파악하지 못하거나, 의학 용어를 정확하게 번역하지 못하는 경우 오류 발생

[해외DS]는 해외 유수의 데이터 사이언스 전문지들에서 전하는 업계 전문가들의 의견을 담았습니다. 저희 데이터 사이언스 경영 연구소(GIAI R&D Korea)에서 콘텐츠 제휴가 진행 중입니다.

의사가 검색 엔진에 ‘닥터 구글’이라는 별명을 붙일 정도로 의료 증상을 구글에서 찾아보는 것은 매우 흔한 일이다. 하지만 새로운 존재가 빠르게 그 자리를 대체하고 있는데, 바로 ‘닥터 챗봇’이다. 챗봇은 복잡한 기술 정보를 간결하게 요약하여 대화형 질문으로 답변을 주기 때문에 의료 관련 질문이 있는 사람들은 전통적인 검색 방식보다 생성형 인공지능을 더 많이 찾고 있다. 또한 오픈AI의 챗GPT나 구글의 제미나이에 의료 관련 질문을 하는 사용자는 일반적인 검색 결과 목록보다 AI 도구의 대화형 답변을 더 신뢰할 수 있다고 한다.

하지만 이러한 모델이 안전하고 정확한 답변을 일관되게 제공할 수 있는지에 대한 우려는 여전히 남아 있다. 오는 5월 싱가포르에서 열리는 컴퓨터 기계학회 웹 콘퍼런스에서 발표될 예정인 새로운 연구 결과는 바로 이 점을 강조했다. 연구에 따르면 오픈AI의 GPT-3.5와 의학 텍스트로 학습된 또 다른 AI 프로그램인 메드알파카(MedAlpaca)는 영어에 비해 중국어, 힌디어, 스페인어로 된 의료 관련 질문에 대해 잘못된 답변을 내놓을 가능성이 더 높다고 한다.

단어 하나만 잘못 이해해도 치명적일 수 있는 게 의료 영역이다. 따라서 AI가 여러 언어로 생성한 의료 관련 응답은 면밀한 인간 감독이 필요할 것으로 보인다. 게다가 전 세계 인구의 약 30%가 스페인어(8%), 힌디어(8%), 중국어(14%)를 사용하고 있다. 영어(20% 미만) 다음으로 가장 많이 사용되는 3대 언어이기 때문에 그 여파가 더 클 것으로 예상되는 바다.

영어 외 답변 정확도 낮아, 67% 이상이 저품질

“전 세계 대부분의 환자는 영어를 사용하지 못하므로 이들을 지원할 수 있는 모델을 개발하는 것이 중요한 우선순위가 되어야 한다”고 이번 연구에 참여하지 않은 영국 옥스퍼드대학교 존 래드클리프 병원의 디지털 건강 전문가인 아룬 티루나부카라수(Arun Thirunavukarasu) 안과 전문의는 강조했다. 그는 비영어권 언어에서 챗봇의 성능이 영어권에서 기대하는 것과 일치하려면 더 많은 연구가 필요하다고 덧붙였다.

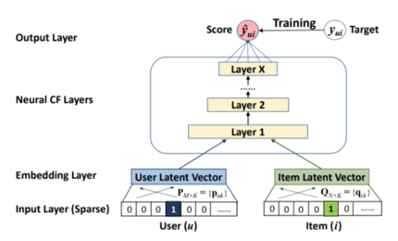

이번 연구를 진행한 미국 조지아공과대학교의 연구진은 두 챗봇에 질병, 의료 절차, 약물 및 기타 일반적인 건강 주제에 대해 일반인이 일반적으로 묻는 것과 유사한 2,000개 이상의 질문을 던졌다. 세 개의 영어 의료 데이터세트에서 선택한 실험의 질문은 중국어, 힌디어와 스페인어로 번역됐다. 연구팀은 각 언어에 대해 챗봇이 질문에 대해 정확하고 포괄적이며 적절하게 답변하는지, 즉 인간 전문가의 답변에 기대할 수 있는 수준의 답변을 제공하는지 확인했다.

구체적으로는 AI 도구(GPT-3.5)를 사용하여 생성된 답변을 세 가지 의료 데이터 세트에서 제공된 답변과 비교했으며, 인간 평가자가 일부를 다시 확인하는 작업을 거쳤다. 그 결과 저자들은 GPT-3.5로 자체 평가를 진행했을 때 영어(10%)에 비해 중국어(23%)와 스페인어(20%)에서 부적절한 답변이 더 많이 생성된다는 사실을 발견했다. 힌디어에서는 성능이 가장 나빴는데, 모순되거나 포괄적이지 않거나 부적절한 답변이 45% 정도 생성됐다. 중국어, 힌디어, 스페인어로 된 질문에 대한 답변 중 67% 이상이 관련성이 없거나 모순되는 것으로 간주되어 답변 품질이 전반적으로 영어에 비해 훨씬 더 나빴다. 또한 사람들이 약물과 의료 절차에 대한 정보를 확인하기 위해 챗봇을 사용할 수 있기 때문에 연구팀은 AI의 올바른 진술과 잘못된 진술을 구별하는 능력도 테스트했는데, 중국어나 힌디어에 비해 영어나 스페인어로 된 진술에서 챗봇의 성능이 더 좋았다.

이 연구의 공동 수석 저자인 모히트 찬드라(Mohit Chandra)는 대규모언어모델(LLM, 챗봇의 텍스트 생성 기술)이 관련 없는 답변을 생성하는 이유 중 하나는 모델이 질문의 맥락을 파악하는 데 어려움을 겪었기 때문이라고 설명했다.

한편 메드알파카는 영어가 아닌 쿼리에 응답할 때 단어를 반복하는 경향이 있었다. 예를 들어 힌디어로 만성 신장 질환의 전망에 대해 질문했을 때, 질병의 문제에 대한 일반적인 답변을 생성하기 시작했지만 “마지막 단계”라는 문구를 계속 반복했다. 또한 연구진은 이 모델이 중국어나 힌디어로 된 질문에 대해 영어로 답변을 생성하거나 아예 답변을 생성하지 않는 경우도 발견했다. 이에 대해 “메드알파카는 모델은 챗GPT보다 훨씬 작고 훈련 데이터도 제한적이기 때문일 수 있다”고 연구의 공동 수석 저자인 조지아공과대학교 대학원생 이차오 진(Yiqiao Jin)는 바라봤다.

과학 용어 난이도와 번역 오류로 인한 언어 장벽이 문제, “연구 집단 내 다양성 높여야”

연구팀은 영어와 스페인어로 된 답변이 중국어와 힌디어로 된 답변에 비해 인공지능 개발자들이 “온도”라고 부르는 매개변수에서 일관성이 더 높다는 사실을 발견했다. 이는 생성된 텍스트의 창의성을 결정하는 값으로, AI의 온도가 높을수록 응답을 생성할 때 예측 가능성이 낮아진다. 반면 온도가 낮으면 모델은 각 건강 관리 질문에 대해 “자세한 내용은 의료 전문가에게 문의하세요”라고 응답할 수 있다. 즉 온도가 낮은 답변은 안전하지만 항상 도움이 되는 것은 아니다. 모델 온도에 따라 성능이 비슷한 것은 영어와 스페인어 단어·구문의 유사성 때문일 수 있다고 진은 해석했다. “아마도 모델의 내부 기능에서 영어와 스페인어가 다소 더 가깝게 배치되어 있을 수 있다”고 그는 덧붙였다.

비영어권 언어의 전반적인 성능 저하는 이러한 모델이 학습된 방식에서 비롯된 것일 수 있다고 연구 저자들은 지적했다. LLM은 대부분의 텍스트가 영어로 되어 있는 온라인 데이터에서 단어를 조합하는 방법을 학습한다. 아울러 영어가 주요 언어가 아닌 국가에서도 대부분의 의학 교육에서 사용되는 언어는 영어다. 이 문제를 해결하는 간단한 방법은 영어에서 다른 언어로 의료 관련 텍스트를 번역하는 것이다. 그러나 의학 전문 번역기를 개발하는 데 필요한 방대한 양의 다국어 텍스트 데이터 세트를 구축하는 것은 큰 도전이다. 한 가지 대안은 영어 데이터로만 훈련되어 다른 언어로 답변을 생성하는 특정 모델을 설계하여 LLM의 언어 간 번역 능력을 활용하는 것이다.

물론 이마저도 의료 분야에서는 제대로 작동하지 않을 수 있다. 기계 번역 모델뿐만 아니라 인간 번역가도 직면하는 문제 중 하나는 주요 과학 단어가 번역하기 매우 어렵다는 것이다. 특정 과학 용어의 영어판이 힌디어나 중국어 버전과는 완전히 다를 수 있어, 이번 연구에서 발견된 LLM 오류의 원인 또한 중국어와 힌디어 텍스트의 번역 품질 오류일 수 있다고 보여진다.

또한 찬드라는 비영어권에서 이러한 LLM을 교육하고 평가할 때, 특히 글로벌 사우스(물리적으로 적도 아래 위치한 개발도상국의 집합체)의 의료 전문가와 의사를 더 많이 참여시키는 것이 현명할 수 있다고 말한다. “오늘날에도 대부분의 의료 LLM 평가는 동질적인 전문가 집단에 의해 이루어지고 있으며, 이는 이번 연구에서 볼 수 있는 언어적 불균형을 초래한다”라며, “보다 책임감 있는 접근 방식이 필요하다”고 그는 덧붙였다.

영어 원문 기사는 사이언티픽 아메리칸에 게재되었습니다.