AI/DS Column

AI talks turned the table and become more pessimisticIt is just another correction of exorbitant optimism and realisation of AI's current capabilitiesAI can only help us to replace jobs in low noise data

Read More

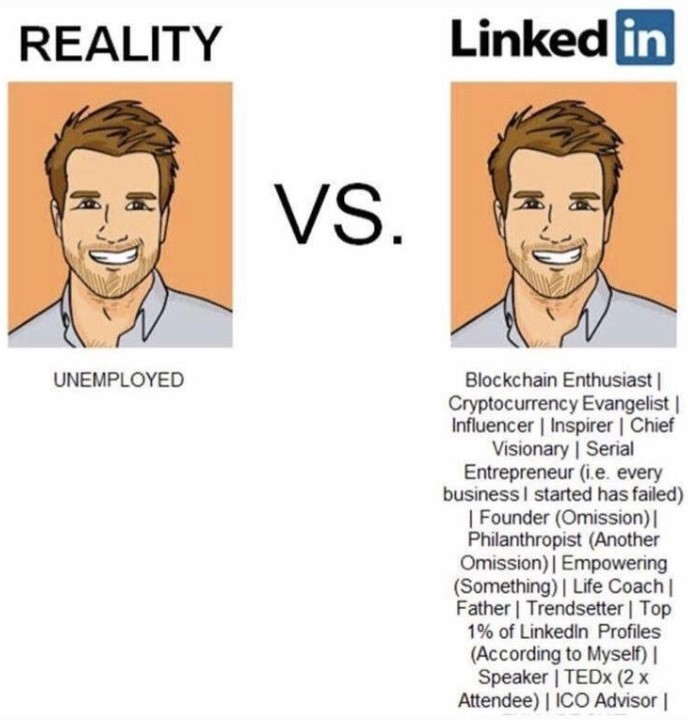

People following AI hype are mostly completely misinformedAI/Data Science is still limited to statistical methodsHype can only attract ignorance As a professor of AI/Data Science, I from time to time receive emails from a bunch of hyped followers claiming what they call 'recent AI' can solve things that I have been pessimistic. They usually think 'recent AI' is close to 'Artificial General Intelligence', which means the program learns by itself and it is beyond human intelligence level.

Read More

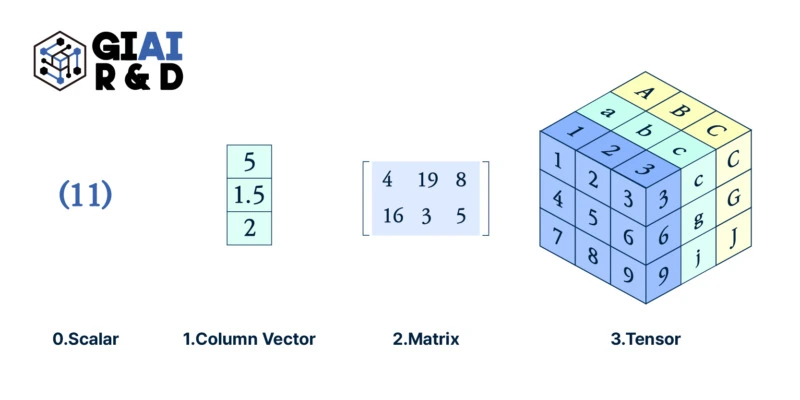

One-variable analysis can lead to big errors, so you must always understand complex relationships between various variables. Data science is a model research project that finds complex relationships between various variables. Obsessing with one variable is a past way of thinking, and you need to improve your way of thinking in line with the era of big data. When providing data science speeches, when employees come in with wrong conclusions, or when I give external lectures, the point I always emphasize is not to do 'one-variable regression.'

Read More